ローカル環境でAIを動かすという選択肢が現実的になってきました。

その中でも注目されているのが Ollama です。

この記事では、Ollamaの基本から実際の使い方、日本語対応モデルまで整理しています。

Contents

Ollamaとは何か

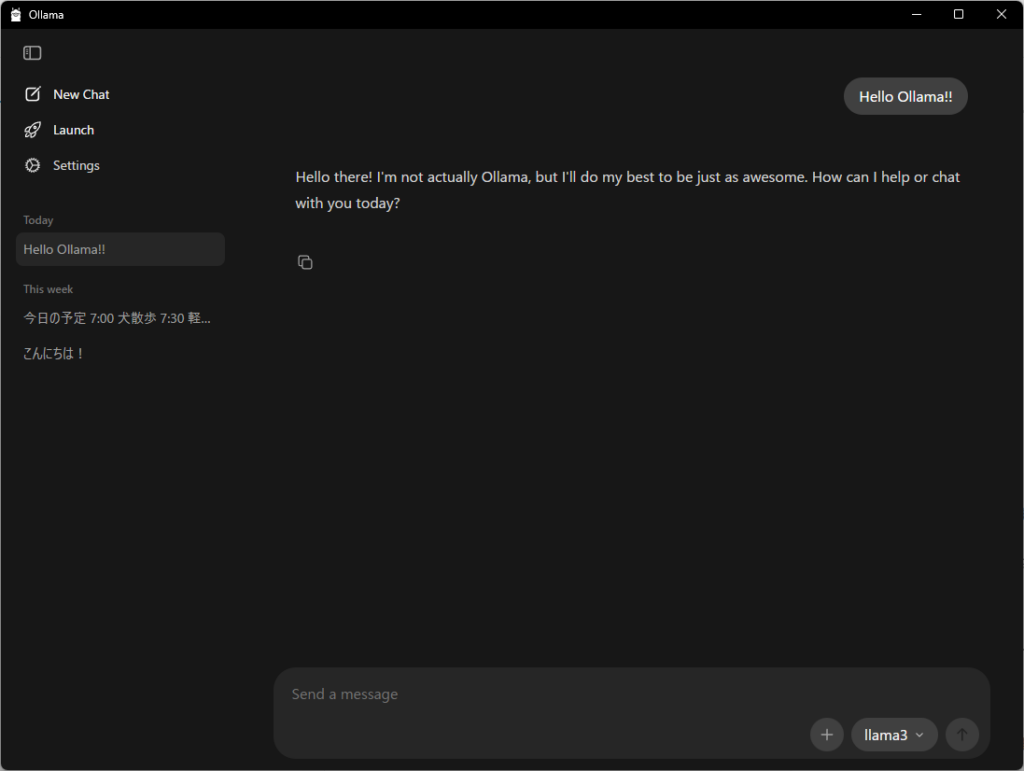

OllamaはローカルPC上で大規模言語モデル(LLM)を実行するための実行環境です。

クラウドを使わずに、手元のマシンでAIを動かせるのが最大の特徴です。

従来のAI利用はAPI経由が主流でしたが、2023年以降はローカル実行のニーズが急速に拡大しています。

その背景には、プライバシー保護とコスト削減があります。

実際、API利用では1,000トークンあたり数円〜数十円かかるのに対し、Ollamaは初期環境さえ整えれば追加コストは基本ゼロです。

また、オフライン環境でも動作するため、業務利用との相性も良いです。

Ollamaの特徴とできること

Ollamaは単なる実行環境ではなく、モデル管理ツールとしても機能します。

モデルのダウンロードから実行までをコマンド一つで完結できる点が強みです。

主な特徴は以下の通りです。

- ローカルでLLMを実行可能

- モデルのインストールが1コマンド

- Mac / Windows / Linux対応

- REST APIとしても利用可能

- 軽量モデルならメモリ8GB程度でも動作

特に「ollama run モデル名」で即実行できるシンプルさは、他ツールと比較してもかなり扱いやすい設計です。

DockerやPython環境構築に苦手意識がある人でも入りやすいです。

インストール方法と初期設定

Ollamaの導入はかなりシンプルです。

公式サイトからインストーラをダウンロードして実行するだけです。

Macの場合はbrewでもインストール可能です。

Windowsは2024年以降正式対応し、導入ハードルが大きく下がりました。

インストール後は以下のコマンドで確認できます。

ollama --version

次にモデルを起動します。

ollama run llama3

この1コマンドでモデルのダウンロードと起動が同時に行われます。

モデルサイズは数GB〜数十GBあるため、初回はダウンロードに時間がかかります。

例えばLlama3 8Bモデルは約4GB前後です。

基本的な使い方と実行例

Ollamaの使い方は非常に直感的です。

CLIとAPIの2つの使い方があります。

CLIでは対話形式でそのまま使えます。

ollama run mistral

これでChatGPTのような対話が始まります。

APIとして使う場合はローカルサーバが立ち上がり、ポート11434で待機します。

例えばcurlで叩くと以下のようになります。

curl http://localhost:11434/api/generate

これにより、自作アプリやWebサービスと連携できます。

PythonやJavaScriptからも簡単に呼び出せるため、個人開発との相性がかなり良いです。

出典:Tech With Tim

日本語対応モデルの実力

Ollamaは英語中心のモデルが多いですが、日本語も十分実用レベルです。

特に最近は日本語対応モデルが増えており、代表的なものとしては以下があります。

- ELYZA系モデル(日本語特化)

- Llama系(多言語対応)

- Mistral系(軽量で高速)

日本語性能はモデルサイズに大きく依存します。

例えば7Bモデルでは簡単な会話や要約は問題ありません。

一方で13B以上になると、自然な文章生成や専門的な内容にも対応できるようになります。

実感としては、ブログ記事レベルなら13B以上が安定、ただし、その分メモリ使用量は増えます。

目安として、13Bモデルは16GB以上のRAMが推奨されます。

OllamaとローカルLLMの位置づけ

ローカルLLMの進化は、トランスフォーマーモデルの効率化研究と密接に関係しています。

代表的なのが 自然言語処理 における軽量化技術です。

例えば量子化(Quantization)により、モデルサイズを最大75%程度削減できることが報告されています。

また、LoRA(Low-Rank Adaptation)という手法では、追加学習コストを大幅に削減できます。

これにより、巨大モデルをそのまま扱うのではなく「軽量化+特化」という方向に進んでいます。

Ollamaはこの流れを実装レベルで体現したツールと言えます。

実際、Llama系モデルのローカル実行は2023年以降急速に普及しました。

さらに、推論速度も改善されており、CPUのみでも毎秒数トークンの生成が可能です。

GPU環境では数十トークン/秒に達するケースもあります。

このような技術進化が、個人PCでAIを扱うという状況を現実にしています。

メリットと注意点

Ollamaは非常に便利ですが、いくつか注意点もあります。

メリットとしては、まずコストがかからない点です。

そして、データを外部に送信しないためセキュリティ面でも安心です。

一方で、ローカルマシンの性能に依存します。

低スペック環境では動作が重くなることがあります。

また、最新の大規模モデル(70Bなど)は現実的に動かすのが難しいです。

そのため、用途に応じたモデル選定が重要になります。

実際に触ってみた所感

正直なところ、「ここまで来たか」という印象です。

昔はAIを動かすにはクラウドが前提、それが今はノートPCで普通に動きます。

特に良いのは、試行錯誤のスピードが速いことです。

API制限や課金を気にせずに触れるのは、開発者にとってかなり大きいです。

一方で、万能ではなく、モデルの選び方やチューニングで結果が大きく変わります。

そのあたりを「道具として使いこなす感覚」が求められる印象です。

出典:freeCodeCamp.org

まとめ

OllamaはローカルAI時代の入口として非常に優秀なツールです。

インストールの簡単さと実用性のバランスが取れています。

日本語対応も進んでおり、ブログや開発用途なら十分使えるレベルです。

今後は軽量モデルの進化により、さらに一般化していく可能性が高いです。

「とりあえず触ってみる」というスタンスでも価値があるツールです。

参考リンク

※生成系AI人気度ランキング|うちのChatGPTが言うには・・・|2026年4月最新版